Nach Verzögerung für Entwickler, öffentliche Betaversion folgt. Technische Lösung für Audiosignale zugänglich machen nach Digitalgesetz.

Apple bringt Live-Übersetzung in Einklang mit EU-Regeln, bald verfügbar

Apple hat seine Live-Übersetzungsfunktion in Übereinstimmung mit den europäischen Digitalregeln gebracht und wird sie in Kürze einführen. Nach einer Verzögerung von mehreren Monaten wird die Funktion zunächst für Software-Entwickler verfügbar sein. Eine öffentliche Betaversion wird dann folgen, wie der iPhone-Konzern bekannt gab.

Die Funktion wurde im Juni vorgestellt und im September in den USA eingeführt. Apple zögerte jedoch den Start in der EU aufgrund europäischer Digitalgesetze hinaus. Der Konzern war vor allem besorgt über die Vorgabe der Interoperabilität, die verlangt, dass technische Fähigkeiten auch anderen Anbietern zur Verfügung stehen müssen. Die Software beherrschte von Anfang an Sprachen wie Deutsch und Französisch – die Funktion war jedoch nicht für Nutzer aus der Europäischen Union verfügbar.

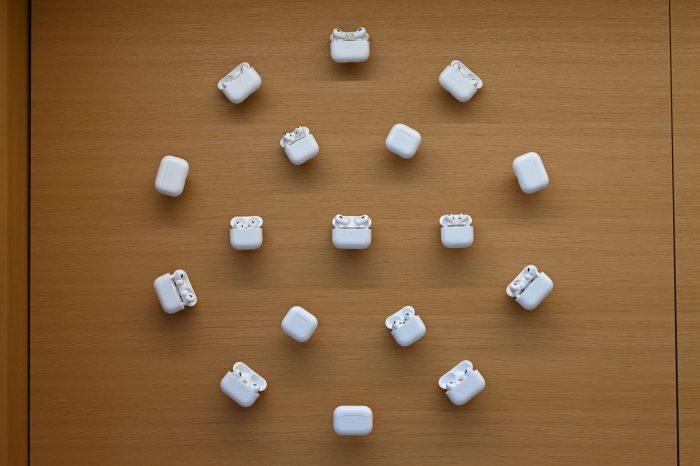

Die Live-Übersetzungen sind kompatibel mit den neuesten Modellen von Apples AirPods-Ohrhörern und iPhones. Dabei werden die Sätze der Gesprächspartner für die Träger der Ohrhörer übersetzt. Wenn beide Personen AirPods tragen, ist eine Unterhaltung in der jeweiligen Sprache möglich.

Knackpunkt bei Audiosignalen

Laut Apple war der Haken in der EU die Art und Weise, wie Audiosignale zwischen den Ohrhörern und dem iPhone hin und her geschickt werden. Ein Nutzer kann zum Beispiel die AirPods tragen und sein Gesprächspartner spricht ins angeschlossene iPhone, wobei die Übersetzungen auf dem Bildschirm angezeigt werden. Dafür hat die Software gleichzeitigen Zugriff auf Lautsprecher und Mikrofon sowohl des iPhones als auch der Ohrhörer.

Die technische Lösung, die dafür sorgt, dass der Ton dabei zwischen den Geräten geleitet wird, müsse man nach dem europäischen Digitalgesetz DMA (Digital Markets Act) auch Konkurrenten zugänglich machen, betont Apple. Dies datenschutzfreundlich umzusetzen, habe einige Monate gedauert. Das Ergebnis ist, dass künftig zum Beispiel ein Kopfhörer-Hersteller die technische Möglichkeit haben wird, gleichzeitig auch direkt auf Mikrofon und Lautsprecher eines iPhones zuzugreifen.Der Konzern weist darauf hin, dass es bei anderen Funktionen länger dauern könne. Zugleich kritisiert Apple weiterhin, dass die «aggressive Interpretation» der DMA-Regeln durch die EU-Kommission Risiken für Nutzer bedeute und schlecht für Innovationen sei.

Die Software erkennt die Sprachen nicht automatisch, sondern sie müssen in Apples hauseigener Übersetzungs-App ausgewählt werden. Die Übersetzung erfolgt auf den iPhones standardmäßig ohne Zugriff auf die Rechenleistung in der Cloud.